Google asegura que los chips Tensor son más eficientes que NVIDIA para áreas como la Inteligencia Artificial

Desde hace mucho tiempo, no habíamos presenciado el surgimiento de una tecnología tan prometedora y, al mismo tiempo, preocupante como la inteligencia artificial.

Bill Gates ha hablado sobre el inicio de una “nueva era” y ha señalado que habrá una revolución que afectará a múltiples industrias. Por otro lado, Elon Musk ha pedido una pausa en el desarrollo de los sistemas más poderosos.

En los últimos tiempos, hemos aprendido que NVIDIA se ha convertido en una pieza clave en el mundo de la inteligencia artificial. Los chips de este fabricante estadounidense ofrecen un gran rendimiento, densidad de cálculo y escalabilidad, y se han utilizado para entrenar modelos tan conocidos como DALL·E y GPT-4.

No obstante, NVIDIA no es la única empresa en este sector, ya que Google también cuenta con sus propios chips y afirma que son superiores a los de NVIDIA.

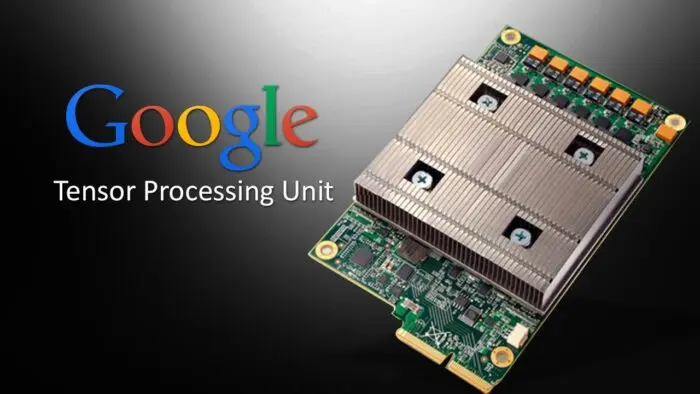

Google entró a la competencia en 2016

En 2016, el gigante de Mountain View presentó sus propias unidades de procesamiento diseñadas para centros de datos de inteligencia artificial, las Google TPU (siglas en inglés de Cloud Tensor Processing Unit).

Con el paso de los años, estas unidades han mejorado significativamente y ahora se utilizan en el 90% de las tareas de aprendizaje automático de la compañía. Son cruciales para el funcionamiento de Google Search y YouTube.

Al igual que Azure de Microsoft, que funciona con hardware de NVIDIA, Google Cloud permite a las empresas y organizaciones externas entrenar sus modelos de inteligencia artificial utilizando su infraestructura en la nube.

En lugar de construir sus propios centros de datos con hardware costoso y difícil de conseguir, estas empresas alquilan la potencia de cálculo necesaria en los centros de datos de Google.

Según una publicación oficial, el popular generador de imágenes a partir de texto, Midjourney, que se ha destacado por su precisión y realismo en su versión más reciente, fue entrenado utilizando la infraestructura de Google Cloud.

Esto significa que los chips de la compañía liderada por Sundar Pichai han desempeñado un papel protagónico en uno de los modelos de IA más famosos de la actualidad. Pero, ¿qué tan buenos son realmente los chips de Google?

Google supera a Nvidia

Un artículo científico publicado por la compañía este miércoles afirma que los Google TPUv4, lanzados en 2021, son hasta 1,7 veces más rápidos y 1,9 veces más eficientes en términos de consumo energético que los NVIDIA A100 lanzados en 2020. Según los autores del artículo, estas comparaciones se realizaron en tareas de entrenamiento de modelos de IA del mismo tamaño.

Aunque la mayoría de los centros de datos actuales utilizan chips NVIDIA A100, las empresas ya están migrando a los NVIDIA H100, que mejoran el rendimiento de su predecesor. Aunque Google no ha anunciado si están trabajando en una nueva versión de sus TPU, es probable que estén desarrollando una para no quedarse atrás en la carrera de la inteligencia artificial.